-

- 人工探索所有的交叉特征是不现实的。

- 难以推广到未曾出现过的交叉特征。

虽然 能够自动探索交叉特征并推广到未出现过的交叉特征,但是

DNN的学习效率不高,且无法显式的学习特征交叉。论文

《Deep & Cross Network for Ad Click Predictions》提出了Deep&Cross Network:DCN模型,该模型保留了DNN的优点。此外,

DCN提出了一种新的cross network,该网络能够高效学习高阶特征交互。实验结果表明:

DCN无论在模型表现以及模型大小方面都具有显著优势。其优点:cross network显式的在每层应用特征交叉,有效的学习了预测能力强的交叉特征,无需人工特征工程。cross network简单高效,可以学习高阶交叉特征。每增加一层,能够学到的交叉特征的阶数就加一阶。- 模型表现更好,且参数要比

DNN少一个量级。

Wide&Deep模型使用交叉特征作为输入,其成功依赖于选择合适的交叉特征。如何选择合适的交叉特征是个指数级问题,目前尚未有明确有效的方法。

DCN模型结构如下图所示,模型包含embedding and stacking层、cross network、deep network三个组成部分。embedding and stacking层:假设输入包含sparse特征和dense特征。设原始特征为向量,其中:

其中

为

field i的one-hot向量, 为经过归一化的dense特征,为向量拼接。

首先将

field i的特征映射到embedding向量:其中

为

one-hot向量长度, 为参数。

然后将

embedding向量和归一化的dense特征拼接成向量:其中 为

的向量长度。

embedding and stacking层就是将 转换为。

cross network:cross network是一个新颖的结构,其核心思想是以高效的方式显式应用特征交叉。cross network由交叉层构成,每层的输入输出为:其中

为第 层的输出,

为第 层的参数。 其中

。

每一层的输出都包含两个部分:该层的输入 、交叉特征

。

cross network的特殊结构使得交叉特征的阶数随着网络的深度加深而增加。对于

层的

cross network,其交叉特征的阶数最高可达 阶。假设

cross network有层,则

cross network部分的参数数量为: 。另外,

cross network的时间复杂度、空间复杂度都是输入维度的线性函数。因此

cross network相对于右侧的deep network部分来讲,其代价几乎是可以忽略不计的。因此DCN的整体时间复杂度、空间复杂度与DNN几乎相同。cross network的本质是用 来捕获所有的特征交叉,这种方式避免了存储整个矩阵以及矩阵乘法运算。

deep network:deep network部分是一个简单的全连接前馈神经网络:其中 为激活函数,

, 为

的向量长度。

假设所有隐层的维度都是 ,一共

层,则

deep network的参数数量为:其中:

- 输入为

,所以第一层的参数数量为:

- 后续的

层,每一层的参数数量为:

- 输入为

通过拼接层

combination layer来拼接cross network和deep network两个网络的输出向量,然后输出到标准的sigmoid输出层:其中 为预测的点击概率,

为

cross network的输出向量, 为deep network的输出向量,为模型参数。

模型的损失函数为带正则化的对数似然函数:

其中

为样本数量, 为样本的真实

label。注意:这里只对dense network的权重进行正则化。DCN训练时联合训练cross network和deep network。

cross network可以理解为:多项式逼近polynomial approximation、FM泛化generalization to FM、或者有效投影efficient projection。为讨论方便,假设

。设 的第

个元素为 。令

,交叉项为 ,其中

为每一项的度

degree。则该交叉项的度为:如果多项式中有多个交叉项,则多项式的度为所有交叉项中

degree的最大值。多项式逼近:

Weierstrass逼近定理表明:在一定条件下,任何函数都可以通过多项式逼近到任意精度。定义多项式:

该多项式的项一共有 个,即参数数量有

个。

- 与之相比,

cross network仅仅包含 的参数就可以达到与相同的度。

- 可以证明: 层的

cross network,其输出可以表示为的各交叉特征的多项式,多项式的度不超过 。

- 与之相比,

FM泛化:在FM中,特征和向量 相关联,交叉特征

的权重为 。而在

DCN中,特征和一组标量 相关联,交叉特征

的权重从两个集合 中的元素相乘项构成。

相同点:二者都是首先学习特征独立的一些参数(如:

),然后交叉项的权重时相应参数的某种组合。

不同点:

FM是个浅层网络,其交叉项的度为2,因此表达能力受限。DCN网络相对较深,能够表达 阶交叉特征,其中为

cross network的深度。

另外和高阶

FM(三阶及其以上)不同,cross network的参数数量是输入特征数量的线性函数,而不是指数函数。效投影

efficient projection:cross network的每一层都是在 和之间计算成对交互

pariwise interaction,然后投影到 维。其中:

- 行向量包含了 各元素,它代表成对交互

pariwise interaction。 是一个对角矩阵,整个矩阵构成了一个分块对角矩阵。

- 行向量包含了 各元素,它代表成对交互

Criteo Display Ads数据集:用于预测广告点击率的数据集,包含13个整数特征,26个类别特征,其中每个类别特征的取值集合(即:cardinality)都很大。数据集经过预处理:

- 整数特征:通过

log函数来归一化 - 类别特征:执行

one-hot编码。

注意:类别特征经过

embedding时,每个特征的embedding维度为 。当拼接所有

embedding特征和整数特征之后,向量维度为1026维。即:embedding and stacking层的输出维度为。

- 整数特征:通过

DCN模型和其它四个模型的对比,这些模型为:LR模型:所有整数特征通过log映射然后离散化。使用单个特征和交叉特征作为输入,其中交叉特征采用一个复杂的特征选择工具来选择。超参数搜索得到最佳超参数:42个交叉特征。

FM模型:标准的FM模型。DNN模型:标准的前馈神经网络模型。超参数搜索得到最佳超参数:5层网络,隐向量维度 1024。

Wide&Deep模型:其wide部分依赖领域知识来构建交叉特征。由于没有一个很好的方法来做交叉特征筛选,因此这里跳过了比较。DeepCrossing模型:它没有显式的特征交叉,而是依赖于stacking和残差单元来构建隐式的特征交叉。超参数搜索得到最佳超参数:5层残差单元,输入维度424,隐向量维度 537。

DCN:超参数搜索得到最佳超参数:deep network为2层,cross layer为6层,deep network隐向量为 1024维。

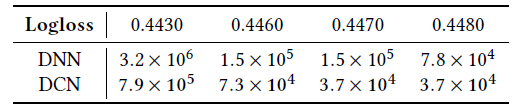

基于验证集

logloss的比较结果:达到指定最佳验证集

logloss需要的参数数量:

给定不同的内存限制,模型大小和效果(验证集

logloss)考察不同网络结构对于

DCN的影响:deep network深度和隐向量维度对于模型效果的影响:所有的结果都是相对于DNN的验证集logloss的绝对数量变化(单位为),负数表示下降。

比较的

DNN模型和DCN模型在deep network上具有相同的结构,只是DNN模型没有cross network而已。